Wie kann KI die Governance Ihrer Unternehmensdaten verbessern?

Laut einem von McKinsey Ende 2022 veröffentlichten Bericht würden 50 % der Unternehmen bereits künstliche Intelligenz einsetzen, um ihre Serviceabläufe zu optimieren und neue Produkte zu entwickeln. Die Entwicklung von KI und Machine Learning im Unternehmensalltag zeigt, welch herausragende Rolle Daten in den Entwicklungsstrategien der Führungskräfte spielen. Um effektiv arbeiten zu können, ist die KI auf große Datensätze angewiesen, die einer methodischen und strengen Governance unterliegen müssen.

Hinter dem Begriff Data Governance steht die Gesamtheit der Prozesse, Richtlinien und Normen, um die Erfassung, Speicherung, Verwaltung, Qualitätssicherung und den Zugang zu Daten innerhalb einer Organisation zu regeln. Welche Rolle spielt die Data Governance? Sie stellt sicher, dass die Daten präzise, sicher, und zugänglich sind und mit den geltenden Vorschriften übereinstimmen. Zwischen KI und Data Governance besteht eine enge Beziehung, denn KI-Modelle lernen aus Daten, und minderwertige oder verzerrte Daten können zu falschen oder diskriminierenden Entscheidungen führen.

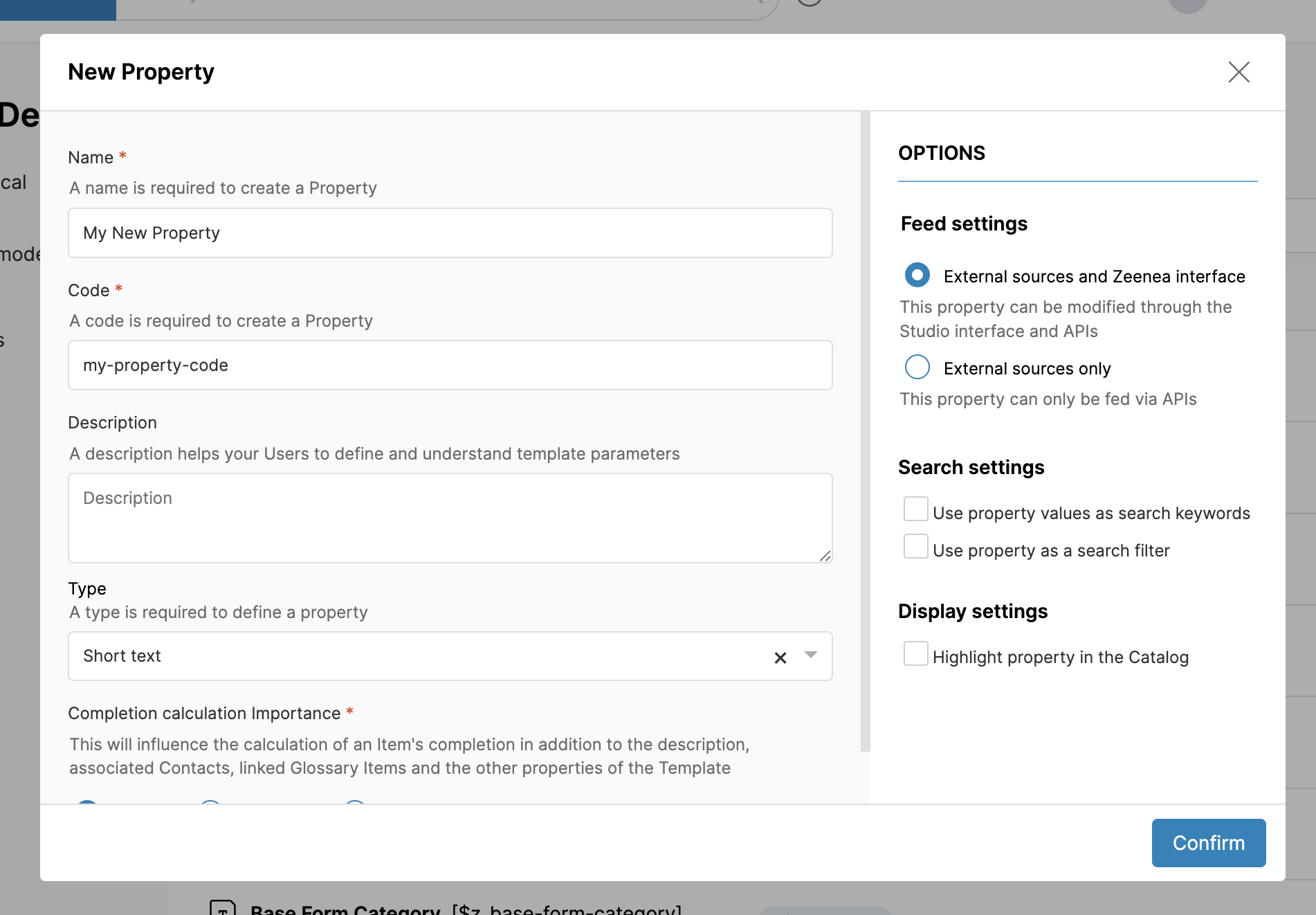

Möchten Sie sicherstellen, dass die von KI-Systemen und ihren Algorithmen verwendeten Daten vertrauenswürdig, ethisch korrekt und datenschutzkonform sind? Dann ist die Data Governance eine unabdingbare Voraussetzung für Sie. Wenn Sie zur selben Zeit ein Doppelprojekt aus KI und Data Governance vorantreiben, schaffen Sie positive Synergien. Die KI kann auf diese Weise direkt zur Verbesserung der Data Governance eingesetzt werden, indem sie Aufgaben wie die Erkennung von Anomalien oder die Klassifizierung von Daten automatisiert.

Zusammenfassung der (zahlreichen!) Vorteile einer Data Governance mit KI-Unterstützung.

Welche Vorteile bietet KI für die Data Governance?

Verbesserung der Qualität Ihrer Daten

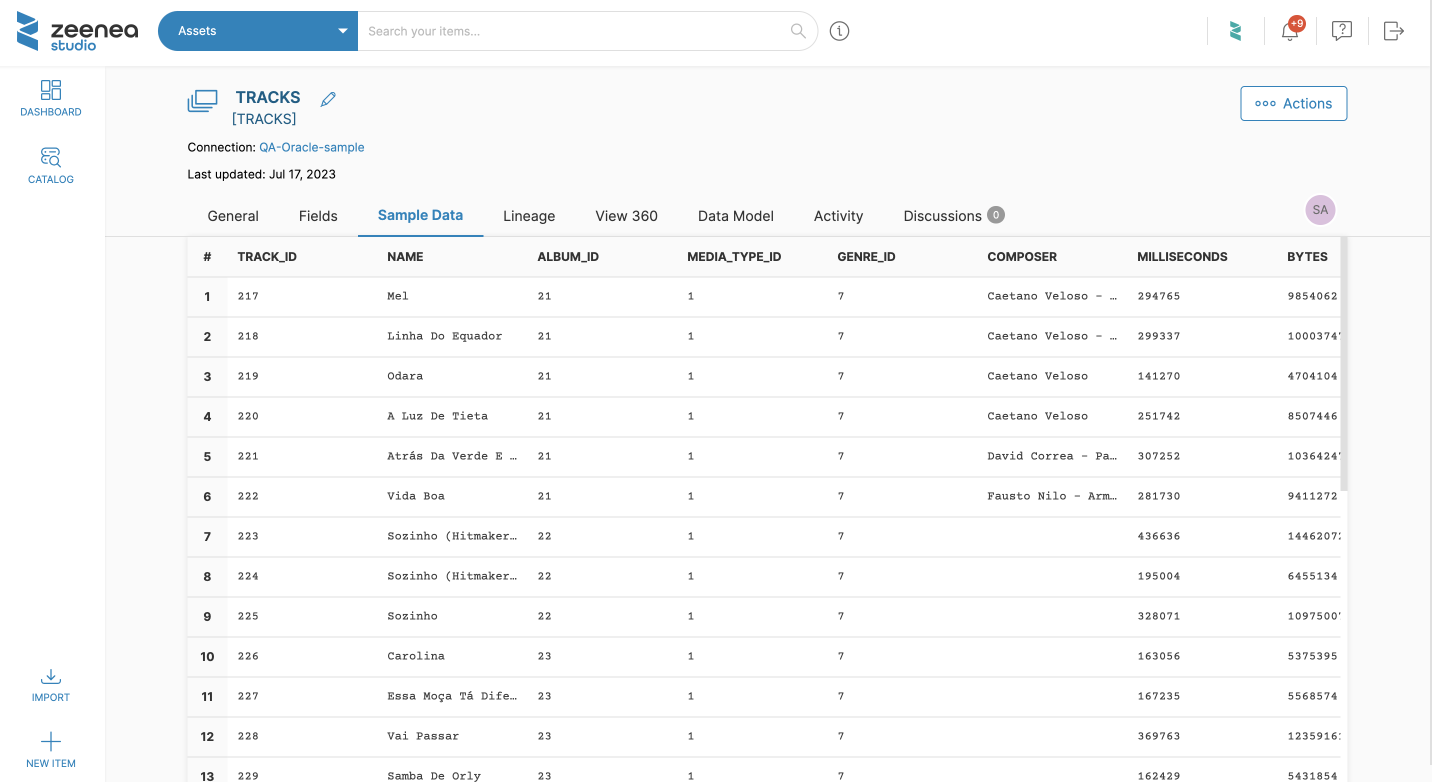

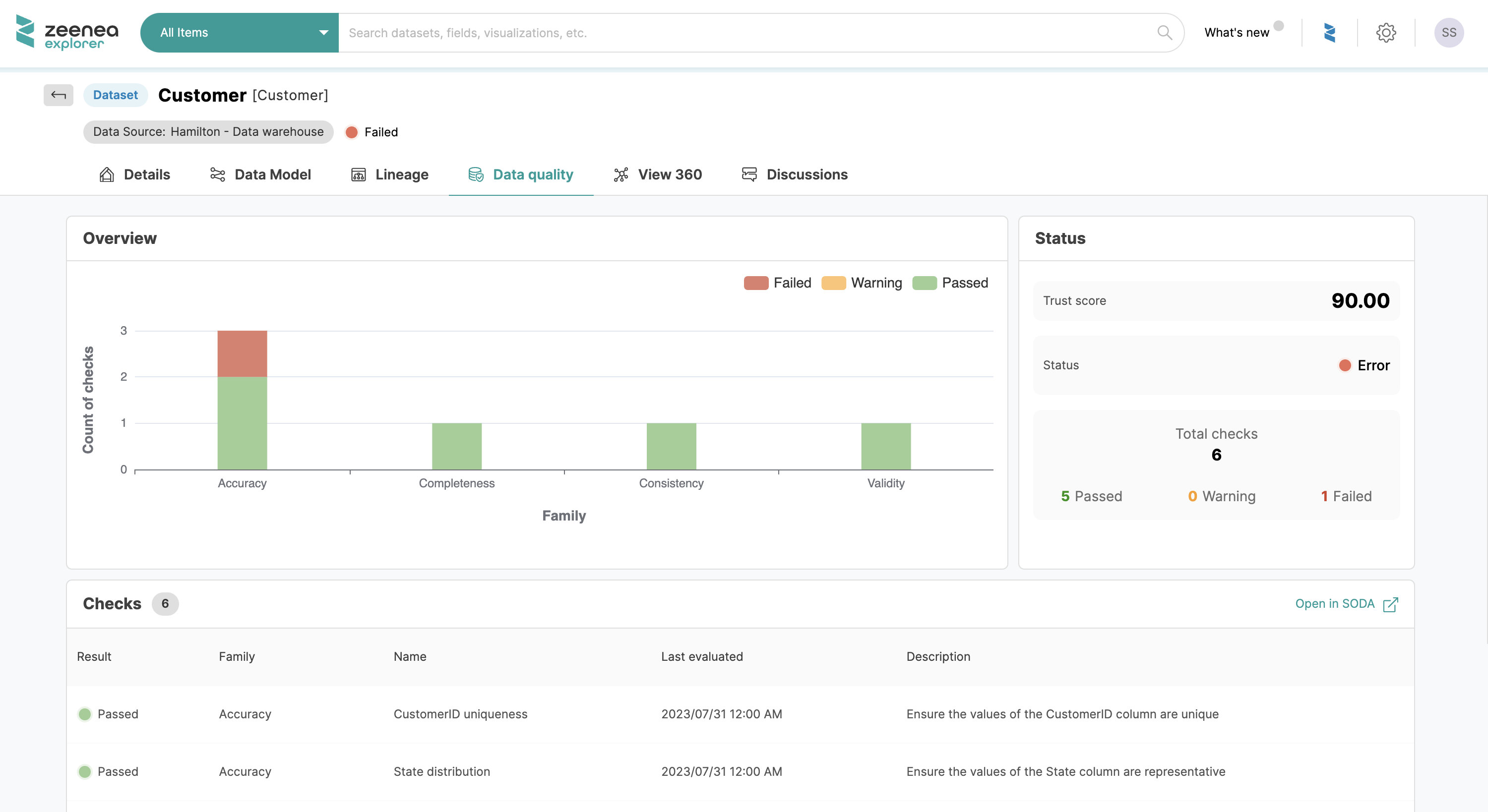

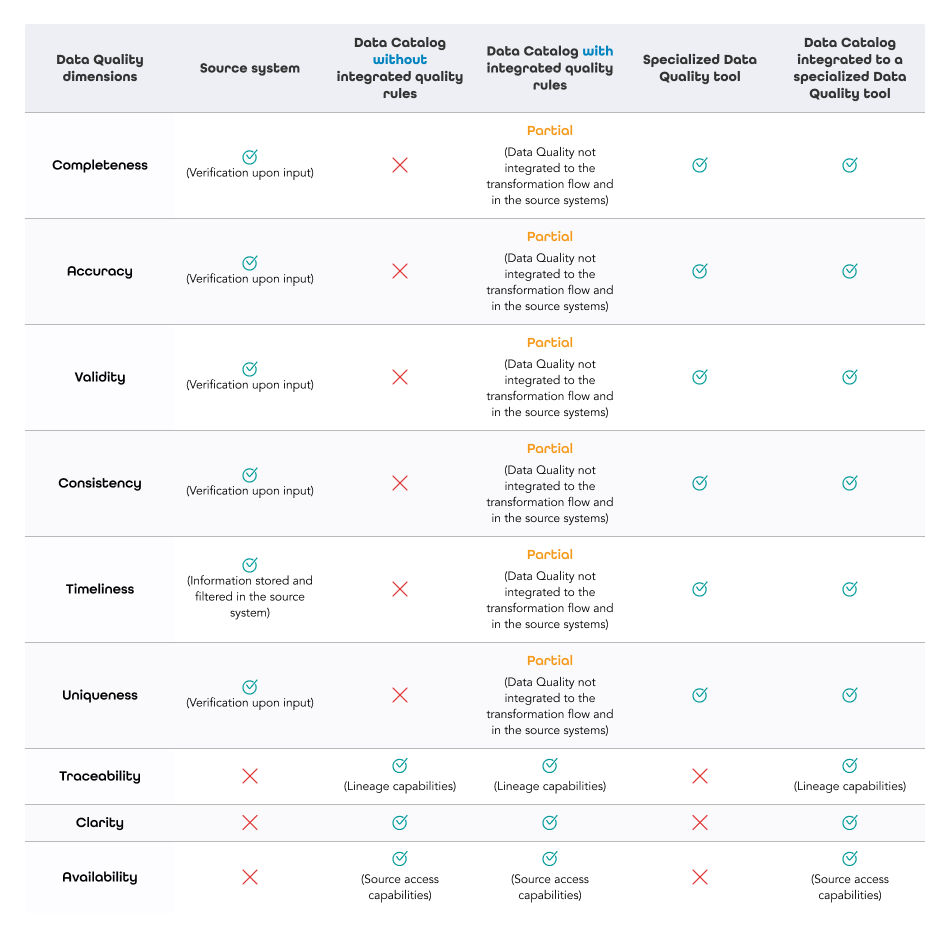

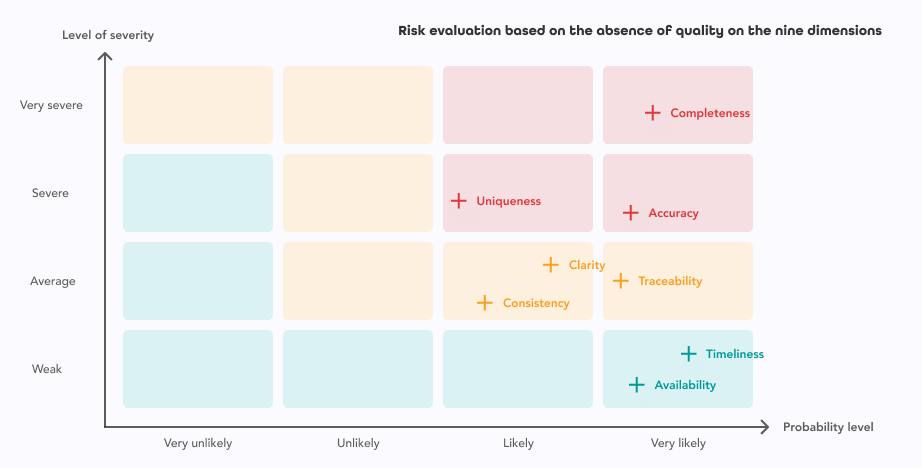

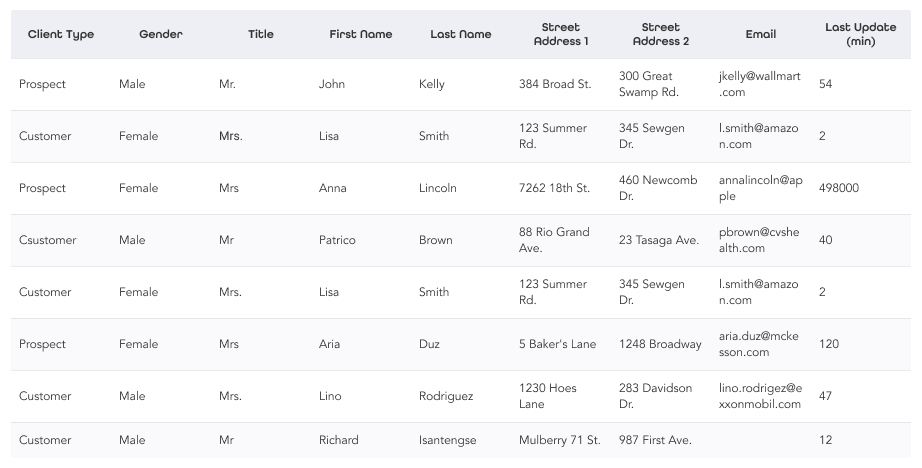

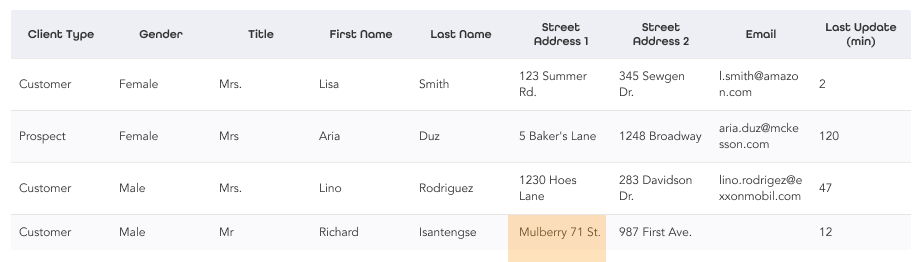

Die Datenqualität muss die Grundlage jeder Datenstrategie sein. Je zuverlässiger die Daten sind, desto relevanter sind die daraus abgeleiteten Erkenntnisse, Entscheidungen und Leitlinien. KI trägt durch mehrere Mechanismen zur Verbesserung der Datenqualität bei. KI-Algorithmen können insbesondere die Erkennung und Korrektur von Fehlern in Datensätzen automatisieren und so Inkonsistenzen und Ungenauigkeiten reduzieren.

Darüber hinaus kann KI dabei helfen, Daten zu normalisieren, indem sie diese auf kohärente Weise strukturiert, damit sie flüssiger und zuverlässiger ausgewertet, verglichen und in einen Zusammenhang gebracht werden können. Mithilfe von maschinellem Lernen (Machine Learning) ist es auch möglich, versteckte Muster und Trends in den Daten zu erkennen und so Fehler oder fehlende Daten zu entdecken.

Automatisierung der Compliance Ihrer Daten

Da die Zahl der Cyberbedrohungen buchstäblich explodiert, muss die Einhaltung der Daten-Compliance in Ihrem Unternehmen absolute Priorität genießen. Die Gewährleistung dieser Compliance setzt jedoch eine ständige Wachsamkeit voraus, die nicht ausschließlich von der menschlichen Intelligenz getragen werden kann. Zumal KI potenzielle Verstöße gegen Datenvorschriften proaktiv überwachen kann. Wie genau? Indem sie alle Datenströme in Echtzeit auf Anomalien oder unbefugte Zugriffe hin analysiert, automatische Warnungen auslöst und sogar Empfehlungen zur Behebung möglicher Probleme macht. Darüber hinaus erleichtert KI die Klassifizierung und Kennzeichnung sensibler Daten und stellt so sicher, dass diese angemessen verarbeitet werden. Außerdem können KI-Systeme automatische Compliance-Berichte erstellen und so den Verwaltungsaufwand reduzieren.

Erhöhen Sie die Sicherheit Ihrer Daten

KI besitzt die Fähigkeit, Bedrohungen durch die Analyse von Datenzugriffsmustern in Echtzeit proaktiv zu erkennen und kann so vor verdächtigem Verhalten wie Eindringversuchen oder unbefugtem Zugriff warnen. Um im Dienste der Data Governance noch einen Schritt weiter zu gehen, nutzt die KI Systeme zur Erkennung von Malware, die auf maschinellem Lernen basieren. Diese Systeme sind in der Lage, Signaturen bekannter Malware zu identifizieren und unbekannte Varianten durch die Analyse ihres Verhaltens zu erkennen. Darüber hinaus trägt sie zur Sicherheit bei, indem sie die Verwaltung von Sicherheits-Patches automatisiert und die Einhaltung von Sicherheitsrichtlinien überwacht.

Demokratisierung der Daten

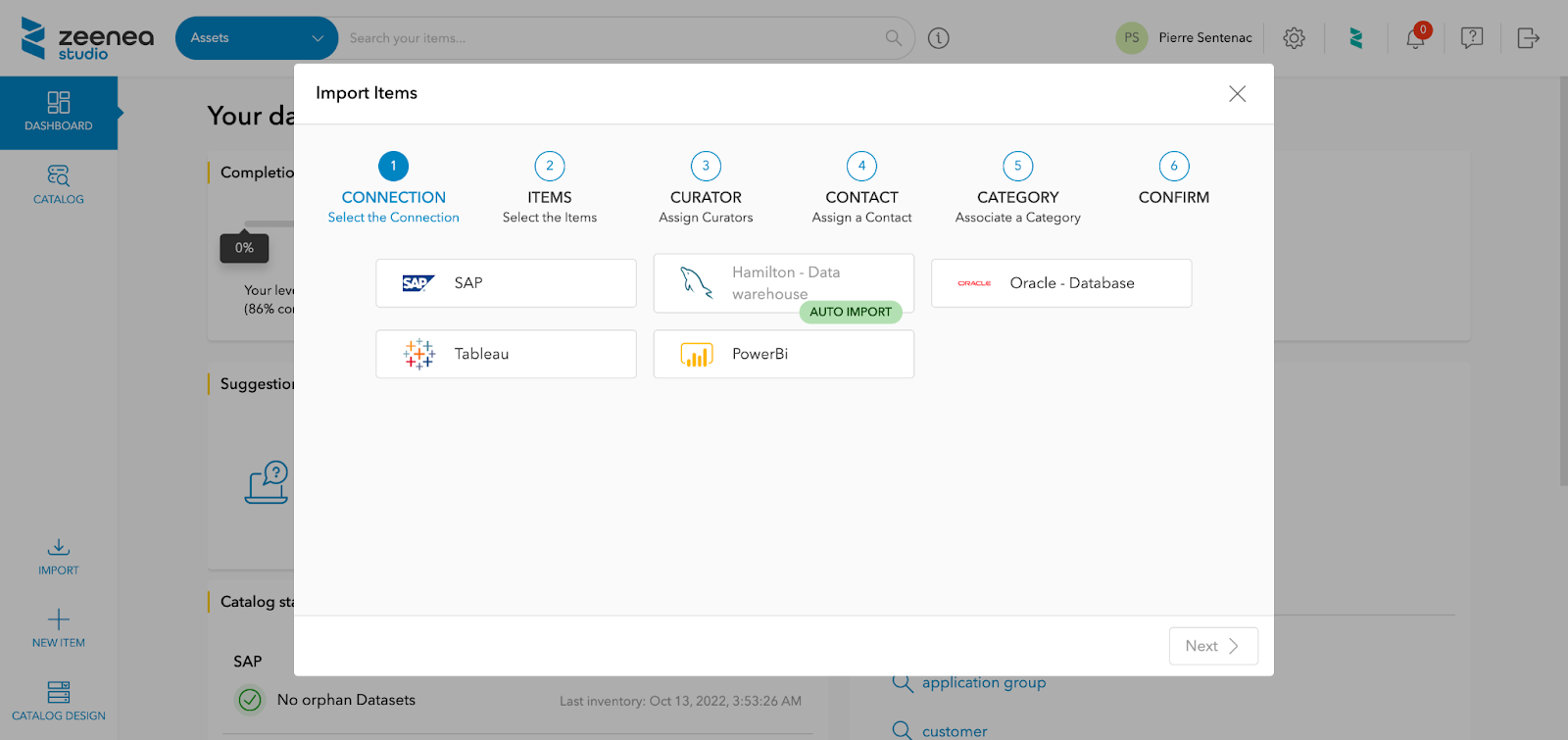

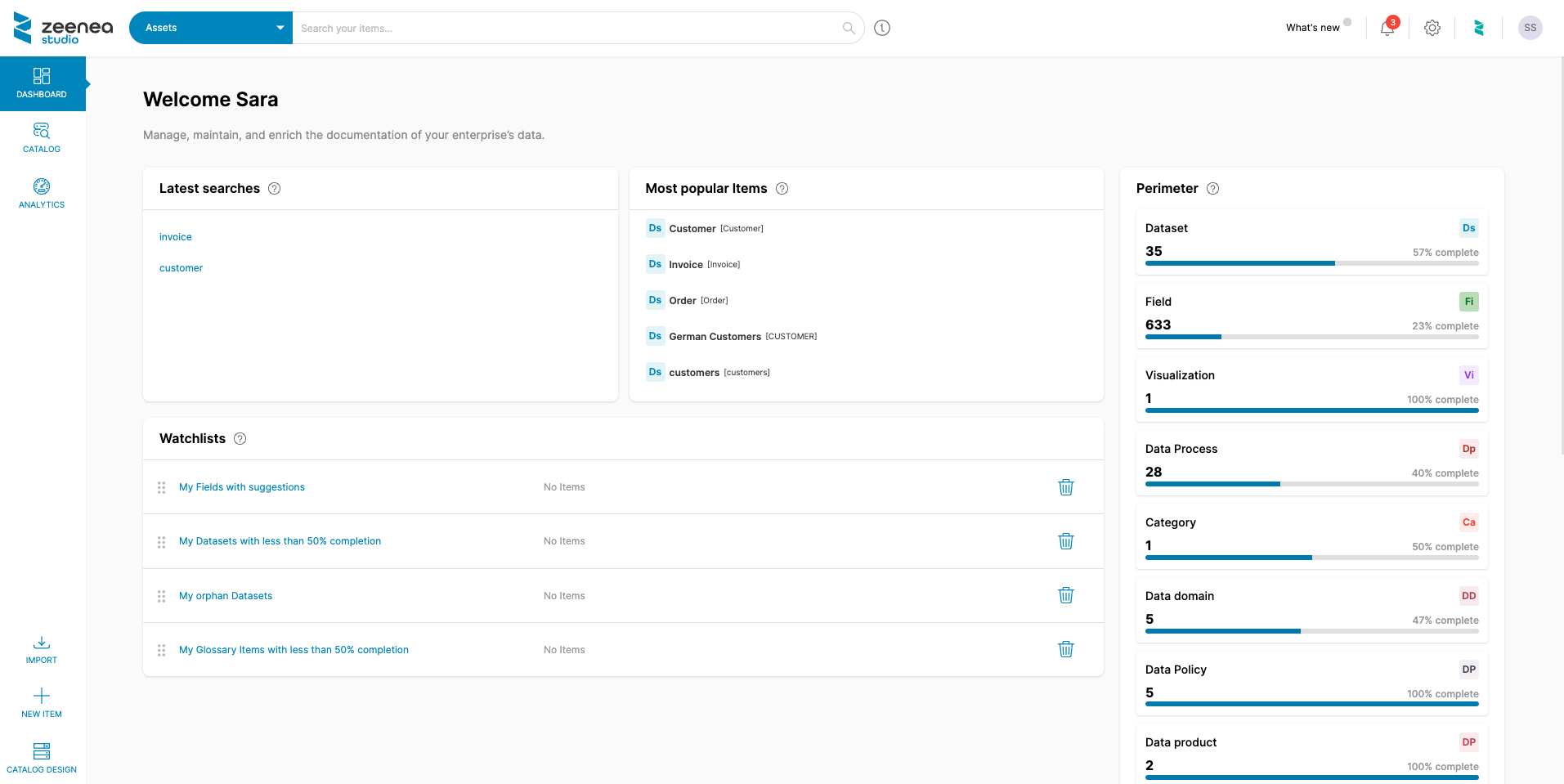

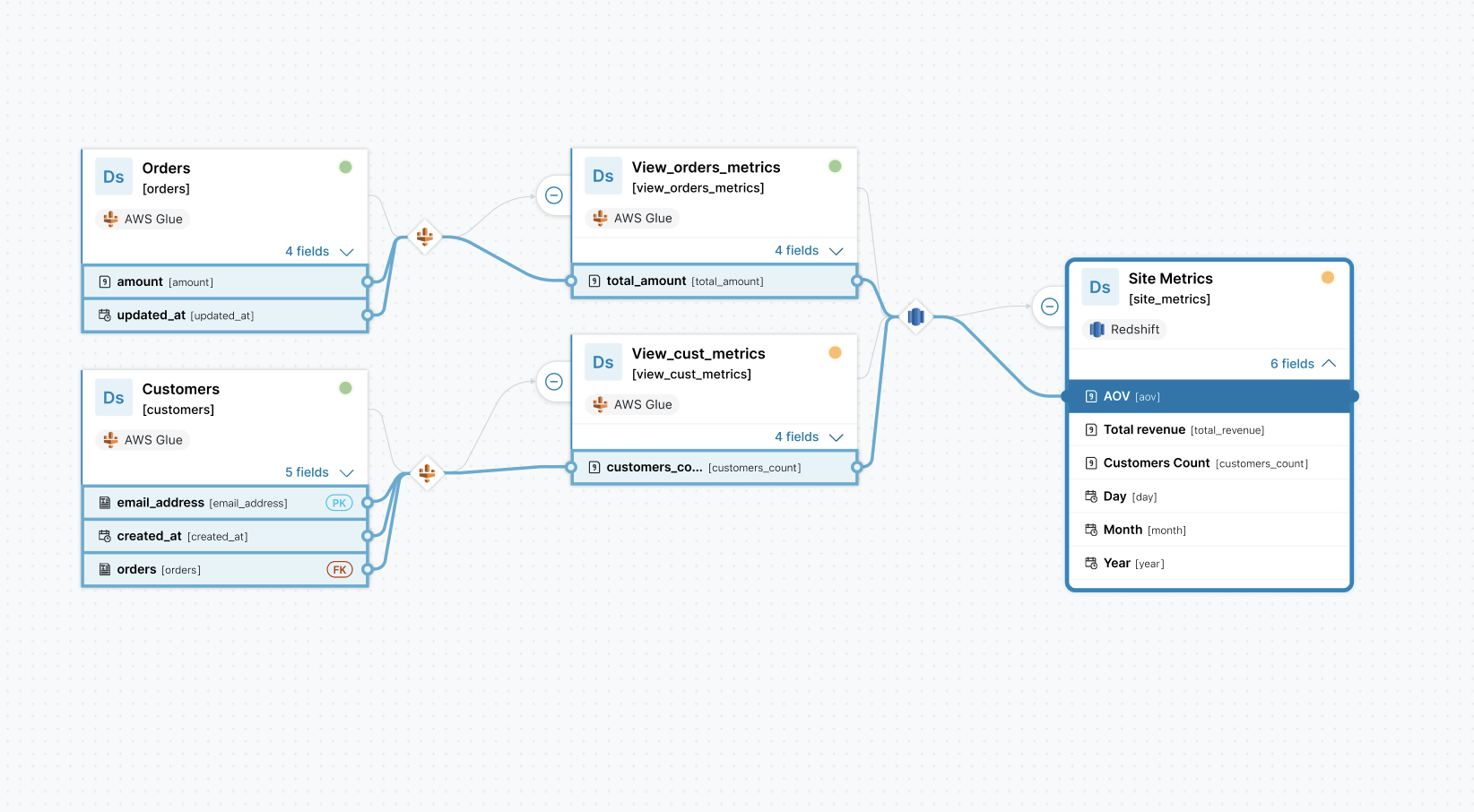

Der Kern Ihrer Datenstrategie beruht auf einem Ziel: Ihre Mitarbeiter sollen ermutigt werden, Daten zu nutzen, wann immer es möglich ist. Auf diese Weise fördern Sie die Entwicklung einer Datenkultur in Ihrer Organisation. Der Schlüssel zum Erfolg liegt darin, den Zugang zu den Daten zu erleichtern, indem Sie die Suche und Analyse komplexer Daten erleichtern. KI-Suchmaschinen können schnell relevante Informationen aus großen Datensätzen extrahieren, sodass Ihre Mitarbeiter in kürzester Zeit das finden, was sie brauchen. Darüber hinaus kann KI die Aggregation und Präsentation von Daten in Form von interaktiven Dashboards automatisieren, wodurch die Daten jederzeit leichter abgerufen und weitergegeben werden können!

Wie sieht die Zukunft der Data Governance aus?

Immer mehr Daten, immer mehr Analysen, immer mehr Vorhersagbarkeit. Das ist der Lauf der Dinge. Dies wird dazu führen, dass die Unternehmen ganzheitlichere Ansätze für ihre Herausforderungen wählen werden. Mehr Höhe, mehr Distanz, für immer mehr Nähe zu ihren Märkten. Um diese Herausforderung zu meistern, ist es von entscheidender Bedeutung, die Data Governance in die globalen Strategien einzubeziehen. In diesem Zusammenhang wird die Automatisierung von entscheidender Bedeutung sein und sich größtenteils auf Werkzeuge stützen, die künstliche Intelligenz und maschinelles Lernens nutzen, um Daten proaktiv zu finden, zu klassifizieren und zu sichern.

Die Zukunft wird unter dem Stern einer stärkeren Zusammenarbeit zwischen IT-, Rechts- und Geschäftsteams stehen, die für den Erfolg der Data Governance und die Aufrechterhaltung des Vertrauens aller Beteiligten von entscheidender Bedeutung ist.